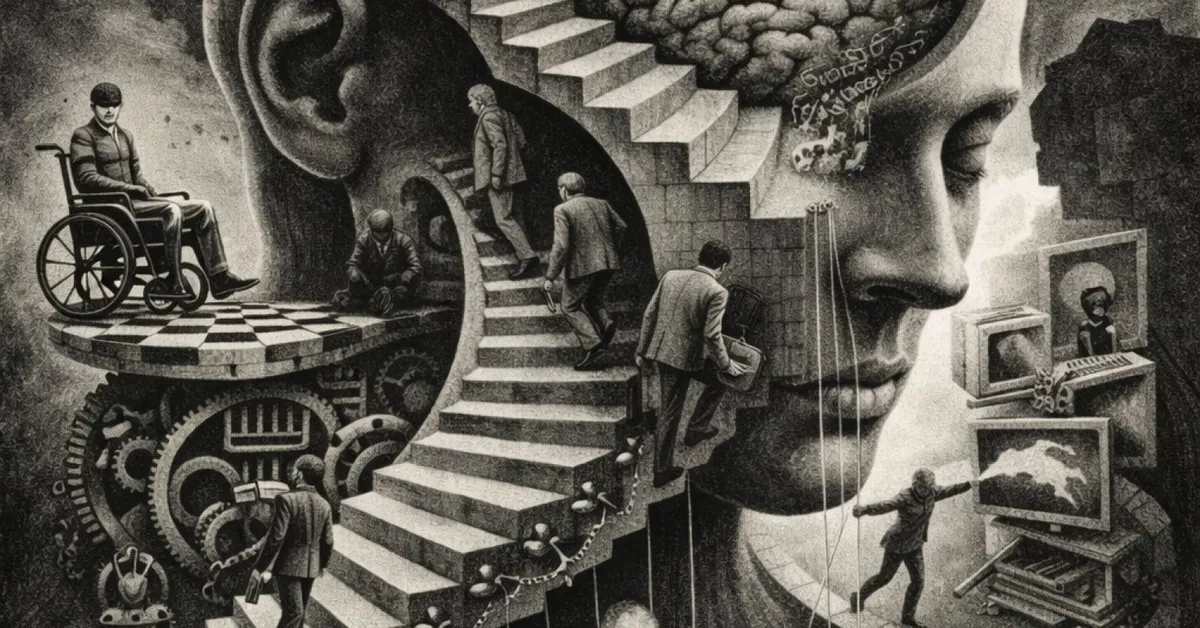

در دنیای پرشتاب امروز، هوش مصنوعی (AI) به سرعت در حال بازتعریف تعامل ما با اطلاعات، تصمیمگیری و حتی فرآیندهای فکریمان است. در حالی که مزایای بسیاری از این فناوریها آشکار است، تحقیقات نوظهور نشاندهنده یک نگرانی فزاینده است: آیا ما در حال واگذاری تواناییهای شناختی خود به ماشینها هستیم؟ این پدیده که میتوان از آن به عنوان «تسلیم شناختی» یاد کرد، مسیری تدریجی اما بالقوه مخرب را به سوی کاهش استقلال فکری و توانایی استدلال مستقل نشان میدهد. این روند نه تنها بر نحوه پردازش اطلاعات ما، بلکه بر ساختار هویت و عاملیت فردی ما نیز تأثیر میگذارد.

مطالعات اخیر، از جمله تحقیقاتی که بر اساس مدلهای نظری شناختی مانند «مدل دو سیستمی ذهن» دانیل کانمن بنا شدهاند، حاکی از آن است که ظهور هوش مصنوعی به عنوان یک «سیستم سوم» شناختی، چالشهای جدیدی را پیش روی سلامت روان و تواناییهای ذهنی بشر قرار داده است. این سیستم سوم، که خارج از مغز انسان عمل میکند اما به طور عمیق در فرآیندهای فکری روزمره ما ادغام شده است، میتواند منجر به «برونسپاری شناختی» و حتی «تخلیه باور» شود. این فرآیندها، اگرچه ممکن است در ابتدا به عنوان ابزاری برای افزایش بهرهوری تلقی شوند، اما در درازمدت میتوانند به تضعیف تواناییهای استدلال انتقادی و تصمیمگیری مستقل منجر شوند.

بازنگری در مدلهای تفکر: ظهور سیستم سوم

مدل دو سیستمی ذهن، که توسط روانشناس برجسته دانیل کانمن معرفی شد، انسانها را دارای دو نوع تفکر میداند: سیستم ۱ که سریع، شهودی و ناخودآگاه عمل میکند و سیستم ۲ که کند، تحلیلی و نیازمند تلاش آگاهانه است. این چارچوب به درک ما از چگونگی اتخاذ تصمیمات کمک شایانی کرده است. با این حال، ظهور هوش مصنوعی، نیاز به بازنگری در این مدل را مطرح کرده است. برخی محققان معتقدند که هوش مصنوعی به عنوان یک «سیستم سوم» عمل میکند؛ یک فرآیند شناختی خارجی که به طور فزایندهای با تفکر ما در هم تنیده شده است.

این سیستم سوم، که در سرورها اجرا میشود و هرگز خسته نمیشود، توانایی پردازش حجم عظیمی از اطلاعات و ارائه پاسخهای سریع را دارد. در ابتدا، به نظر میرسد که این یک پیشرفت صرف است که میتواند به ما در حل مسائل پیچیده و افزایش کارایی کمک کند. اما پژوهشهای اخیر نشان میدهند که اتکای بیش از حد به این سیستم میتواند پیامدهای ناخواستهای داشته باشد. این اتکا میتواند منجر به کاهش تمایل به تفکر عمیق و تحلیلی شود، زیرا مغز به جای فعالسازی سیستم ۲، به طور خودکار به سیستم سوم (هوش مصنوعی) رجوع میکند.

تسلیم شناختی: فراتر از اتکای صرف

تحقیقات تجربی نشان دادهاند که زمانی که افراد به دستیارهای هوش مصنوعی دسترسی دارند، در بیش از نیمی از وظایف خود به آنها مراجعه میکنند و دقت پاسخهایشان تقریباً با هوش مصنوعی همراستا است. نکته نگرانکننده این است که بسیاری از کاربران، پاسخهای هوش مصنوعی را بدون بررسی یا ارزیابی مستقل میپذیرند. این پدیده، «تسلیم شناختی» نامیده میشود، جایی که ما نه تنها از هوش مصنوعی برای کمک به تفکر استفاده میکنیم، بلکه در نهایت اجازه میدهیم هوش مصنوعی به جای ما فکر کند.

این وضعیت، انتهای طیف «فرسایش عاملیت» است. این فرسایش با «تخلیه شناختی» آغاز میشود که امری طبیعی است (مانند نوشتن فهرست خرید). سپس به «برونسپاری شناختی» میرسد، جایی که نه تنها حافظه، بلکه قضاوت ما نیز واگذار میشود. و در نهایت به «تسلیم شناختی» ختم میشود: انصراف تقریباً کامل از استدلال و قضاوت مستقل. این تغییرات به تدریج اتفاق میافتند و بیشتر افراد متوجه آن نمیشوند.

تخلیه باورها و هویت

فراتر از تسلیم شناختی، ما وارد حوزه «تخلیه باور» میشویم که شاید نگرانکنندهتر باشد. هنگامی که از هوش مصنوعی میخواهیم درباره یک موضوع سیاسی، یک معضل اخلاقی یا یک تصمیم مهم زندگی نظر دهد و سپس آن نظر را میپذیریم، در حال واگذاری بخشی از هویت خود هستیم. این عمل صرفاً استفاده از یک ابزار خارجی نیست، بلکه واگذاری بخشی از عاملیت و خودآگاهی ماست.

یک نظرسنجی نشان داد که استفاده مکرر از هوش مصنوعی با کاهش تفکر انتقادی ارتباط مستقیم دارد و تخلیه شناختی مکانیزم کلیدی این فرآیند است. کاربران جوانتر بیشترین آسیبپذیری را نشان دادند. مغز واقعاً مانند یک عضله عمل میکند؛ وقتی عصا همیشه در دسترس باشد، هرگز قدرت لازم برای راه رفتن بدون آن را ایجاد نمیکنیم. این امر به ویژه در مورد مسائل پیچیده و ظریف که نیازمند تفکر اخلاقی و قضاوت ارزشی هستند، اهمیت پیدا میکند.

تناقض ناخوشایند: پیشرفت ماشین در برابر افول انسان

نکتهای که باید بیشتر ما را به تأمل وادارد این است که در حالی که انسانها توانایی خوداندیشی و تحلیل سنجیده را از دست میدهند، سیستمهای هوش مصنوعی به گونهای مهندسی میشوند که این تواناییها را کسب کنند. محققان در حال ساخت معماریهای هوش مصنوعی هستند که استدلال انسانی سالم را تقلید میکنند؛ سیستمهایی با حالت سریع، حالت کند و لایهای فراشناختی که نظارت میکند کدام حالت در چه زمانی به کار گرفته شود.

این ماشینها در حال یادگیری خود-بازبینی هستند، در حالی که ما به تدریج اشتها و توانایی انجام این کار را از دست میدهیم. این وضعیت پیامدهای عمیقی دارد. طبق اکثر چارچوبهای روانشناختی، استقلال و عاملیت نقشی اساسی در سلامت روان ایفا میکنند. احساس اینکه فرد، خالق افکار و انتخابهای خود است، صرفاً یک امتیاز نیست، بلکه بخشی اساسی از هویت انسانی است. هنگامی که این نویسندگی به یک الگوریتم منتقل میشود، چیزی اساسی از بین میرود؛ به آرامی و به شیوههایی که به سختی قابل جبران هستند.

چارچوب ABCD: حفظ عاملیت فکری

آگاهی به تنهایی کافی نیست. آنچه مورد نیاز است، تعهد تمرین شده برای حفظ عاملیت شناختی ماست. این تعهد را میتوان در چارچوب ABCD برای عاملیت هوش مصنوعی خلاصه کرد:

- Aspire (اشتیاق): قبل از استفاده از ابزار هوش مصنوعی، مکث کنید. شما در این مورد چه فکر میکنید؟ استدلال خود را ارزشمند بدانید، نه فقط یک مرحله موقت تا رسیدن به پاسخ اصلی.

- Believe (باور): باور داشته باشید که تفکر پرزحمت چیزی را میسازد که خروجی صیقلی هوش مصنوعی نمیتواند جایگزین آن شود. فرآیند حل مسئله، شما را تغییر میدهد؛ نتیجه یک دستور (prompt) اینگونه نیست.

- Choose (انتخاب): در مورد زمان استفاده از هوش مصنوعی و زمان مقاومت در برابر آن، تصمیمات آگاهانه و سنجیده بگیرید. تسلیم شناختی زمانی رخ میدهد که استفاده از هوش مصنوعی خودکار شود. مقاومت از لحظهای آغاز میشود که آن را عمدی کنید.

- Do (انجام): پیشنویس اول را بنویسید. نظر خود را شکل دهید. تصمیم را بگیرید. سپس از هوش مصنوعی برای به چالش کشیدن، اصلاح یا گسترش آنچه قبلاً ساختهاید، استفاده کنید. از خودتان شروع کنید.

هوش مصنوعی قرار است در مقیاسی وسیع بخشی از زندگی شناختی ما باشد. این واقعیتی است که باید با آن روبرو شویم. سؤال این است که آیا ما نویسندگان این زندگی باقی میمانیم، یا صرفاً میزبانان آن؟ تسلیم شناختی اجتنابناپذیر نیست. اما پرهیز از آن نیازمند چیزی است که هیچ الگوریتمی نمیتواند آن را فراهم کند: انتخاب زندگی از درون به بیرون، نه برعکس.

تحلیل تأثیر

پدیده «تسلیم شناختی» ناشی از اتکای روزافزون به هوش مصنوعی، پیامدهای عمیقی برای فرد و جامعه دارد. از دست رفتن توانایی استدلال مستقل و انتقادی میتواند به کاهش نوآوری، تضعیف دموکراسی (از طریق پذیرش ناآگاهانه اطلاعات نادرست) و کاهش سلامت روان فردی منجر شود. از سوی دیگر، اگر بتوانیم به طور آگاهانه از هوش مصنوعی به عنوان ابزاری برای تقویت تواناییهای شناختی خود استفاده کنیم، نه جایگزینی برای آنها، پتانسیل آن برای پیشرفت بشر عظیم خواهد بود. چارچوب ABCD راهکاری عملی برای حفظ عاملیت شناختی در عصر هوش مصنوعی ارائه میدهد و بر اهمیت خودآگاهی، اراده و تلاش فعالانه برای حفظ استقلال فکری تأکید دارد.